Yapay zeka destekli otonom silah sistemlerinin savaş alanındaki yükselişi, insan müdahalesini azaltarak uluslararası insancıl hukukun temel ilkelerini tehdit etmektedir. Özellikle ayrım gözetme ilkesine uyum, bu sistemlerin etik, hukuki ve teknik sınırlılıkları nedeniyle ciddi bir krize dönüşmektedir. Bu durum, acil tartışmalar gerektirir.

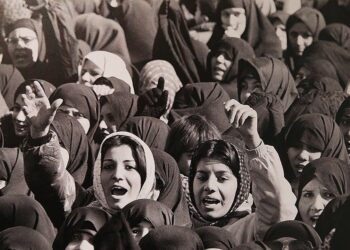

Yapay zeka destekli sistemler; bilhassa insansız hava araçları (İHA’lar) ve otonom hedefleme algoritmaları ve veri analitiği platformları son yıllarda modern savaşın temel araçları haline gelmiştir. Bu teknolojiler, yalnızca savaş alanında taktik avantajlar sağlamakla kalmayıp aynı zamanda hedef belirleme, ön analiz, veri toplama ve saldırı koordinasyonu gibi birçok alanda insan karar alma süreçlerini büyük ölçüde değiştirmiştir (Scharre, 2019). Savaş hukukunun temel ilkeleri olan ayrım gözetme, orantılılık ve önlem alma yükümlülükleri göz önüne alındığında bu yeni gelişmeler ve stratejiler uluslararası insancıl hukuk (UİH) açısından ciddi sorunları gündeme getirmiştir. Özellikle ihlallerin, can ve mal kayıplarının ciddi oranlara ulaştığı Gazze gibi bölgelerde bu teknolojilerin kullanım biçimleri; yapay zeka destekli sistemlerin kullanımının ne ölçüde hukuka uygun olduğu hakkında gerek hukuki gerek etik tartışmaları beraberinde getirmiştir.

Bu çalışmada, yapay zeka destekli sistemlerin doğası, uygulama örnekleri ve potansiyel ihlalleri; uluslararası insancıl hukuk ilkeleri bağlamında tartışılacaktır. Şu anda, mevcut yapay zeka destekli silah sistemlerinin teknolojisi silahlı çatışma alanında istihbarat toplama, gözetleme, keşif yapma, hedef belirleme ve angajman yeteneklerine haizdir. Yakın zaman içerisinde bu sistemler insan müdahalesi olmaksızın kendi kararlarını verebilme yeteneği ile üst düzey otonomluk seviyesine ulaşacaktır. Devletler, bu alan üzerinde ciddi yol haritaları ve planlar geliştirmektedir. Bizim ise bu analiz ile amacımız, uluslararası hukuk ilkeleri ve insan hakları ile dijital savaş araçlarının nasıl bir etkileşim içerisinde olduğunu ortaya koymaktır.

Ayrım Gözetme İlkesi ve Yapay Zeka Sistemleri

Silahlı çatışmalarda uluslararası insancıl hukuk kurallarının uygulanması, çatışan tarafların hedeflerin yasallığına dair ortak bir zeminde buluşmasıyla sağlanabilir. Savaşçılar, çatışmalara doğrudan katılan siviller ve askeri hedeflerin belirlenmesi; bunun yanında hangi kişilerin veya nesnelerin saldırıdan korunması gerektiğine dair tespitlerin yapılmasını gerektirir. Peki, otonom silah sistemleri, ayrım gözetme ilkesine saygı gösterme yetisine sahip olabilecek midir? Bu soruyu cevaplamadan önce, otonom silah sistemlerinin tanımlanmasında dahi devletler ortak bir zeminde buluşamadığını belirtmek gerekir. Silah sistemleri, bir dizi farklı işlev arasında dağıtılan değişen derecelerde otonomluk içerebilmektedir. Bu nedenle otonomluğu bir spektrum veya spektrumlar dizisi olarak düşünmek daha faydalıdır. Otonom silah sistemleri, insanın konumunun üç farklı aşamada olması ile ayrılabilir. İlki, insanın karar verme döngüsünün içinde bulunduğu “human-in-the-loop” değerlendirmesidir. Bu sistem içerisinde, kritik karar ve yönlendirme insana bırakılmaktadır. Bu sistemlere örnek Kuzey Kore ile Askerden Arındırılmış Bölge boyunca potansiyel hedefleri belirlemek ve izlemek için sensörler kullanan ve bir sınır savunma sistemi olan Güney Kore’nin SGR A-1 Sentry’si verilebilir. “Human-on-the-loop,” insanın döngünün üzerinde olduğu, ilk tanımlamaya göre karar mekanizmalarını düzenledikten sonra müdahaleci izleyici konumunda olduğu değerlendirmedir. Bu sistemin örnekleri arasında gemi merkezli ABD’nin Aegis’i ile C-RAM denilen kara merkezli Karşı Roket, Topçu ve Havan Sitemi ve İsrail’in Demir Kubbe’si yer almaktadır. Sonuncusu ise “human-out-of-the-loop,” insanın değerlendirme döngüsü dışında kaldığı durumlar için kullanılan tanımlamadır. Otonom robotlar için kullanılabilir. Mevcut otonom silah sistemlerinin yaygın olarak alıntılanan örneklerinden biri İsrail’in Harpy’sidir. Harpy, geniş bir alan üzerinde düşman radarlarını arayarak bulan bir anti-radar silahıdır. Kriterlerini karşılayan herhangi bir radar tespit etmesi halinde radarı bombalayarak onu yok etmektedir.

Otonom Silah Sistemlerinin Tanımlanmasına İlişkin Ortak Düzlem

Otonom silah sistemlerini tanımlamak için ortak bir düzlem bulunamamasının ardındaki nedenler çok çeşitlidir. Hükümetler, siyasi irade, uluslararası düzeyde çatışan çıkarlar ve savunma politikalarının hepsi, menfi bir ortaklık içerisindedir. Otonom silah sistemleri savunucuları ve karşıtları, temelde karşıt görüşe sahip her iki taraf; kendi amaç ve çıkarlarına hizmet edecek olan tanımları oluşturmak için gayret sarf edecektir. Tanımsal tartışma, gerçeklerin değer açısından tarafsız bir tartışması değil, politik ve stratejik motivasyonlarla yönlendirilen bir tartışmadır.

Uluslararası silahlı çatışma bağlamında ayrım gözetme ilkesi, Cenevre Sözleşmeleri’ne Ek Protokol I’in 48. Maddesinde düzenlenmektedir. Buna göre; “Sivil nüfusa ve sivil nesnelere saygı gösterilmesini ve korunmasını sağlamak amacıyla, çatışmanın tarafları her zaman sivil halk ile savaşçılar ve sivil nesneler ile askeri hedefler arasında ayrım yapacak ve … operasyonlarını yalnızca askeri hedeflere yönlendireceklerdir.” Uluslararası olmayan silahlı çatışmalar bağlamında ise Cenevre Sözleşmeleri’ne Ek Protokol II ayrım gözetme ilkesini “Sivil halk ve sivil kişiler, askeri operasyonlardan kaynaklanan tehlikelere karşı genel korumadan yararlanır” ve “Sivil nüfus ve bireysel siviller saldırının hedefi olmayacaktır. Temel amacı sivil halk arasında terör yaymak olan şiddet eylemleri veya tehditleri yasaktır” şeklinde 13(1). ve 13(2). maddeleri ile güvence altına almaktadır. Askeri hedefler yalnızca “doğası, konumu, amacı veya kullanımı itibarıyla askeri harekata etkili bir katkı sağlayan ve tamamen veya kısmen yok edilmesi, ele geçirilmesi veya etkisiz hale getirilmesi, o dönemde geçerli olan koşullar altında kesin bir askeri avantaj sunan” nesneleri içerir. Şüpheli durumlarda bireyler savaşçı değil sivil olarak değerlendirilmelidir. Benzer şekilde, “normalde sivil amaçlara tahsis edilen” nesnelerin, askeri harekatlara etkili bir katkı sağlamak amacıyla kullanılıp kullanılmadıkları konusunda şüphe duyulması durumunda, sivil nesneler olduğu varsayılmalıdır. Bu maddelerle düzenlenen ayrım gözetme ilkesi, hem insancıl hukukun temel bir ilkesidir hem de uluslararası teamül kuralıdır. Dolayısıyla antlaşmalara taraf olmayan devletleri de bağlamaktadırlar.

Yapay Zekanın Karar Alma Süreçleri ve Teknoloji Şirketleri

Yapay zeka ürünü sistemlerin, makine öğrenmesi ve çeşitli yollarla gözlem ve tanıma bağlamında insanları alt eden bir rakip olduğu ortadadır. Ancak sistemler, muhakeme noktasında gerçek insani algı yerine makine öğrenimi ve büyük veri kaynaklı oldukları için oldukça yetersizlerdir. Yapay zekanın karar alma süreçleri bu noktada black box olarak nitelendirilebilir. Karmaşık ve dinamik çatışma ortamlarında otonom silah sistemlerine programlanabilecek algoritmalara ve yazılım kodlarına dönüştürülmesi ve otonom silahların bu şekilde çatışma anında ayrım gözetme ilkesine uyum sağlamasının sağlanması hiç de kolay görünmemektedir. Şu halde otonom silah sistemlerinin hangi kriterlere göre askeri hedefleri belirlediği çoğu zaman şeffaf değildir. Bu durum, sistemlerin kullanılmasının hukuki hesap verilebilirliğini zayıflatmaktadır. İsrail’in Lavender adlı yapay zeka örneğinde görüldüğü gibi, binlerce kişilik hedef listeleri yapay zeka aracılığıyla otomatik olarak oluşturulmakta ve bu kişiler “şüpheli bağlantılar” gibi puslu bir tanımlama ile soyut kriterlere dayanarak hedef gösterilmektedir. Sistem, bireylerin sosyal çevresi, telefon kayıtları ve geçmiş dijital davranışlarına göre hedef listeleri oluşturmuştur. Bu, açıkça ayrım gözetme ilkesinin makine kararına terk edilmesi anlamına gelir. Modern savaş alanlarındaki ayrım, giderek daha fazla oranda özel teknoloji şirketlerinin geliştirdiği yapay zeka sistemlerine bırakılmakta ve bu da savaş hukukunun temel normlarını ciddi şekilde tehdit etmektedir. Bu bağlamda, Google’ın Project Maven girişiminden de bahsetmemiz gerekir. Project Maven, ABD Savunma Bakanlığı için geliştirilen yapay zeka destekli görüntü analiz sistemidir. Proje amacı, İHA’lardan elde edilen görüntüleri analiz ederek düşman hedeflerini tanımlamak ve bu bilgiyi gerçek zamanlı işleyerek operasyonel kararlar almaktır. Bu sistemde kullanılan algoritmaların nasıl eğitildiği, hangi veri setlerinin kullanıldığı ve sistemin sivil-savaşçı ayrımını nasıl yaptığı belirsizdir. Sivillerin davranışsal örüntülere göre potansiyel hedefler olarak belirlenmeleri, ayrım gözetme ilkesine aykırı sonuçlar doğurmaktadır. Dikkat çekici bir diğer sistem ise Amazon Web Services’in teknoloji sağlayıcısı olduğu Amerikan istihbarat kurumları ve Savunma Bakanlığı için geliştirilen JEDI (Joint Enterprise Defense Infrastructure) ve C2E (Commercial Cloud Enterprise) gibi projelerdir. Amazon, bu noktada savaş sahasından gelen çoklu veri kaynaklarını gerçek zamanlı olarak işleyebilecek güçlü bir bulut altyapısı sunmakta ve bu da askeri karar destek sistemlerinin temelini oluşturmaktadır. Adı geçen sistemler, yüz tanıma, hareket takibi, sinyal kesiti ve coğrafi bilgi sistemleriyle entegre hareket ederek sivil-savaşçı ayrımının makine odaklı alınmasını mümkün kılar. Ancak bu kararların nasıl alındığına dair algoritma şeffaf değildir. Daha da önemlisi, Amazon’un bu sistemlerin geliştirilmesi için sağladığı altyapı ve veri işleme kapasitesi ayrım gözetme yükümlülüğünü doğrudan etkileyen bir operasyonel müdahale anlamına gelir fakat şirketin bu durum karşısında hiçbir hukuki yükümlülüğü bulunmamaktadır. Amazon’un savaşla ilişkili bulut altyapıları sadece teknik destek olarak değerlendirilmemelidir; zira karar alma sürecine veri yönünden etkide bulunmak, ayrım gözetme ilkesinin etik ve normatif arka planını da şekillendirmektedir. Bu durum, şirketin açık bir savaş aktörü olmasa bile, çatışmaların hukuki sınırlarını bulanıklaştırdığı ve etik sorumluluğu artırdığı anlamına gelir.

Öldürme otonomluğu, belki de silah sistemlerinin karşılaştığı en büyük hukuki ve ahlaki engel olarak karşımıza çıkmaktadır. İnsan Hakları İzleme Örgütü’nün de aralarında bulunduğu 65 ülkedeki 165 sivil toplum örgütünden oluşan bir koalisyon olan Katil Robotları Durdurma Kampanyası, otonom silahları yasaklamak ve böylece insan kontrolüne sahip silahlar gerektiren bir rejimi sürdürmek için çalışmaktadır. Ek olarak BM Genel Sekreteri Antonio Guterres, 2018 senesinden bu yana ölümcül otonom silah sistemlerinin kabul edilemez ve ahlaka aykırı olduğunu savunmuş ve bunların uluslararası hukuk kapsamında yasaklanması çağrısında bulunmuştur. Uluslararası Kızılhaç Komitesi, Mayıs 2021 itibariyle tam otonom silah sistemlerinin yasaklanmasını desteklemiştir.

Her halükarda, bu sistemlerin gelişmesi silah teknolojisinde barut ve nükleer silahlardan sonra silahlı çatışmalardaki üçüncü askeri devrim olarak kabul edilmiştir. Bütün devletler, yapay zeka ile çalışan komplike silahlara sahip olabilmek için yarışmaktadırlar. Otonom silah sistemlerinin yasaklanması, şu halde fazla iyimser kalmaktadır. Zira önü alınamaz bir silahlanma yarışının henüz başındayız; savaş ise bütün dünyayı tehdit eden bir unsur haline gelmiştir. Mevcut duruma objektif olarak baktığımızda devletlerin yapabilecekleri en iyi şeyin, ortak bir düzlemde buluşabilmek olduğunu görebiliriz.

Kaynakça

Amnesty International. (2023). Automated Apartheid: Facial Recognition in Occupied Palestine. https://www.amnesty.org/en/documents/mde15/6701/2023/en/ adresinden erişildi.

Arman, P. (2023). Otonom silah sistemlerinin uluslararası insancıl hukukun ayrım gözetme ilkesi çerçevesinde değerlendirilmesi [Evaluation of autonomous weapon systems within the framework of the principle of distinction under international humanitarian law]. Kadir Has Üniversitesi Hukuk Fakültesi Dergisi (KHASHFD), 11(2), 457–483.

Crootof, R. (2016). The killer robots are here: Legal and policy implications. Cardozo Law Review, 36(5), 1837–1915.

Geneva Conventions Additional Protocol I. (1977). Protocol Additional to the Geneva Conventions of 12 August 1949, and relating to the Protection of Victims of International Armed Conflicts (Protocol I). https://ihl-databases.icrc.org/en/ihl-treaties/api-1977 adresinden erişildi.

Geneva Conventions Additional Protocol II. (1977). Protocol Additional to the Geneva Conventions of 12 August 1949, and relating to the Protection of Victims of Non-International Armed Conflicts (Protocol II). https://ihl-databases.icrc.org/en/ihl-treaties/apii-1977 adresinden erişildi.

Greenwald, G. (2021). Securing the Cloud: AWS and Government Surveillance. New York, NY: Beacon Press.

International Committee of the Red Cross. (2021). Position on autonomous weapon systems. https://www.icrc.org/en/document/icrc-position-autonomous-weapon-systems adresinden erişildi.

Pazarcı, H. (2022). Uluslararası hukuk (15. bs.). Ankara: Turhan Kitabevi.

Scharre, P. (2019). Army of none: Autonomous weapons and the future of war. New York, NY: W. W. Norton & Company.

Sparrow, R. (2007). Killer robots. Journal of Applied Philosophy, 24(1), 62–77. doi:10.1111/j.1468-5930.2007.00346.x

Taddeo, M., & Blanchard, A. (2022). A comparative analysis of the definitions of autonomous weapons systems. Science and Engineering Ethics, 28(5), 3.

Time. (2024, March 15). How Israel uses AI in Gaza—and what it might mean for the future of war. TIME Magazine. https://time.com/7202584/gaza-ukraine-ai-warfare/ adresinden erişildi.

UN Secretary-General. (2018). Remarks on lethal autonomous weapons. United Nations. https://www.un.org/sg/en/content/sg/statement/2018-03-29 adresinden erişildi.

UNIDIR. (2017). The weaponization of increasingly autonomous technologies: Concerns, characteristics and definitional approaches. https://unidir.org/wp-content/uploads/2023/05/the-weaponization-of-increasingly-autonomous-technologies-concerns-characteristics-and-definitional-approaches-en-689.pdf

UNIDIR. (2025). The interpretation and application of international humanitarian law to lethal autonomous weapon systems. https://unidir.org adresinden erişildi.

UNODA. (2021). Lethal autonomous weapons systems and responsibility under international law. https://www.un.org/disarmament/publications adresinden erişildi.

Wakabayashi, D., & Shane, S. (2018, June 1). Google will not renew Pentagon contract that upset employees. The New York Times. https://www.nytimes.com/2018/06/01/technology/google-pentagon-project-maven.html adresinden erişildi.

Winter, E. (2020). The compatibility of autonomous weapons with the principle of distinction in the law of armed conflict. International and Comparative Law Quarterly, 69, 456.